View

Claude Code를 무료로 쓰는 방법은 존재하는가? Ollama로 로컬 LLM을 연결해 보았다

출처: Ollama 공식 문서

요즘 주변에서 Claude Code를 무료로 쓸 방법이 없느냐는 질문을 자주 받는다. Anthropic Pro 월 $20도 부담인데 Max는 $100~$200에 달하니, 학생이나 개인 개발자에게는 살벌한 가격이다. 그러나 결론부터 말하면 Claude Code 무료 사용은 분명히 가능하다. 심지어 2026년 들어 Ollama가 공식 Claude Code 통합을 내놓으면서 ollama launch claude 한 줄이면 충분하다. 별도의 프록시도 필요 없다. 직접 RTX 4090 + Windows WSL2 환경에서 1주일을 굴려 보았고, 어떤 모델이 쓸만한지, 어느 지점에서 막히는지 정리해 보았다.

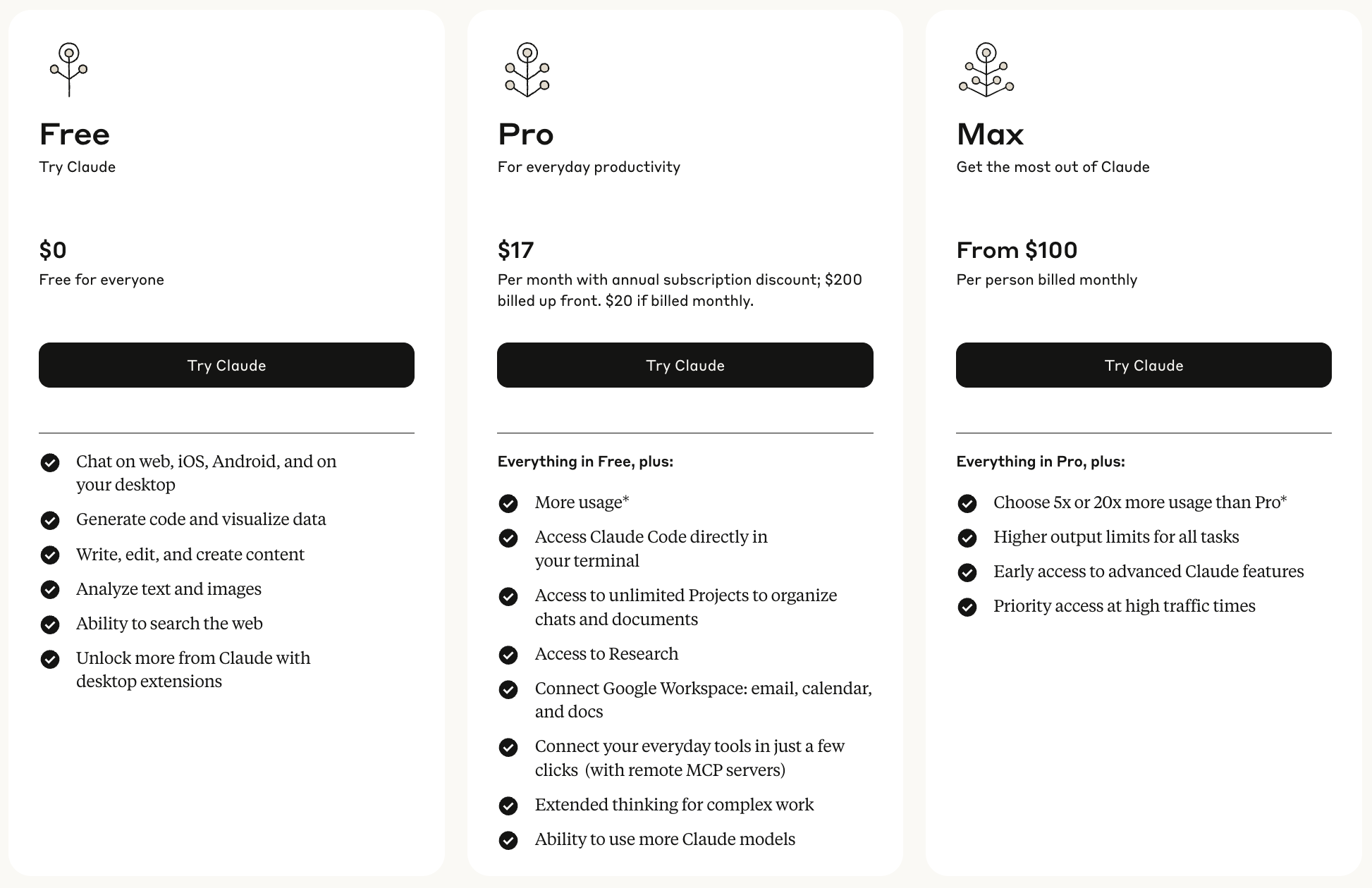

Claude Code 공식 요금부터 정리한다

각설하고, 왜 무료가 절실한지부터 짚고 가야 한다. 2026년 4월 기준 Anthropic Claude Code 요금은 다음과 같이 나뉜다.

- Pro $20/월: Sonnet 4.5 중심, 5시간 단위로 사용량이 리셋된다. 대형 리팩토링을 한두 번만 돌려도 한도에 도달한다.

- Max $100/월: Pro의 약 5배 사용량이다. 매일 8시간 빡세게 쓰는 사용자 기준으로 그럭저럭 버틴다.

- Max $200/월: Opus까지 풀로 쓸 수 있는 등급이다. 사이드 프로젝트를 두세 개 동시에 돌리는 시니어 개발자용이다.

문제는 토큰 단위 과금이 아니라 사용량 제한 방식이라는 점이다. 한도를 초과하면 그대로 막힌다. ccusage 같은 도구로 실제 토큰을 측정해 보면 에이전트 한 번 돌릴 때 입력 50K + 출력 5K 수준이 나온다. 하루 10번만 돌려도 60만 토큰이다. 이것이 누적되면 Pro로는 1주일도 버티지 못하는 케이스가 흔하다.

Claude Code 무료가 절실해지는 사용자 유형

개인 토이 프로젝트만 돌리는 사용자는 한 달 평균 사용량이 Max 한도의 10%에도 미치지 못한다. 그런데 사용량 변동이 커서 어떤 주는 거의 0, 어떤 주는 폭주한다. 학습 목적으로 코드 읽기만 시키는 경우도 마찬가지로 비용 효율이 떨어진다. 회사에서 외부 API가 차단된 상황 역시 답이 없다. 이런 사용자들이 Claude Code 무료 키워드로 몰려드는 것이다.

Claude Code가 로컬 LLM을 쓸 수 있는 원리

Anthropic 공식 문서를 뒤지면 한 줄이 나온다. ANTHROPIC_BASE_URL 환경변수로 다른 엔드포인트를 바라보게 할 수 있다. 즉 Claude Code 클라이언트는 단지 HTTP 요청을 쏘는 주체일 뿐이며, 그 요청을 누가 받느냐는 사용자가 지정할 수 있다는 뜻이다.

예전에는 여기서 함정이 있었다. Claude Code가 보내는 요청은 Anthropic Messages API 포맷이고, Ollama는 기본적으로 OpenAI 호환 포맷(/v1/chat/completions)을 쓰기에, 중간에 포맷 변환 프록시(claude-code-router 같은 것)를 끼워야 했다. 그러나 2026년 들어 Ollama가 Anthropic Messages 포맷을 네이티브로 받는 엔드포인트를 열었다. http://localhost:11434로 그대로 꽂으면 된다. 별도 라우터는 불필요하다.

공식 통합 vs 써드파티 프록시

이제 선택지는 단순해졌다. 공식 Ollama 통합이 기본값이며, 라우터는 특수 상황에서만 필요하다.

- Ollama 네이티브 (공식 권장):

ollama launch claude한 줄로 환경변수 자동 세팅과 Claude Code 실행까지 이루어진다. 로컬 모델과 Ollama Cloud 모델을 모두 지원한다. - claude-code-router: 여러 프로바이더(OpenRouter, Groq, OpenAI)를 모델별로 라우팅하고자 할 때만 필요하다.

- litellm: 회사 단위로 50여 개 프로바이더를 통합하고 캐싱/로깅까지 걸고자 할 때 쓴다.

개인 개발자라면 Ollama 네이티브 방식만 쓰면 된다. 이 글의 이후 설명도 공식 통합 기준이다.

출처: paddo.dev

Ollama 설치부터 모델 선택까지

Ollama는 운영체제별로 설치 방식이 조금씩 다르다. Windows 사용자가 한국에 많은데 가이드는 Mac 위주라 답답한 경우가 많아, 세 환경을 모두 정리한다.

Windows (WSL2 권장):

curl -fsSL https://ollama.com/install.sh | sh

ollama serve

Windows 네이티브 설치도 가능하긴 하다. 다만 Claude Code 역시 결국 git-bash나 WSL에서 돌리는 편이 안정적이므로 WSL2로 통일하는 쪽이 정신건강에 좋다.

macOS:

brew install ollama

ollama serve

Linux (Ubuntu/Debian):

curl -fsSL https://ollama.com/install.sh | sh

sudo systemctl start ollama

설치가 끝나면 http://localhost:11434에서 API가 열린다. 이제 모델만 받으면 된다.

2026년 기준 Claude Code 공식 추천 모델

Ollama 공식 문서가 Claude Code와 짝으로 권장하는 모델 목록이다. 클라우드 모델은 Ollama 계정만 있으면 :cloud 태그로 바로 호출되며, 로컬 모델은 ollama pull로 받으면 된다.

| 모델 | 타입 | 체감 용도 | 비고 |

| kimi-k2.5:cloud | Ollama Cloud | 긴 컨텍스트 + 에이전트 루프 | 대형 리팩토링용 최상위 추천 |

| glm-5:cloud | Ollama Cloud | 범용 코딩 | Tool Use 안정성 양호 |

| minimax-m2.7:cloud | Ollama Cloud | 멀티모달 포함 작업 | 이미지 + 코드 혼합 프로젝트용 |

| qwen3.5:cloud | Ollama Cloud | 한국어 혼합 코드 | 한국어 주석이 자연스럽다 |

| glm-4.7-flash | 로컬 | 빠른 응답이 필요할 때 | 상대적으로 가볍다 |

| qwen3.5 | 로컬 | 일반 로컬 작업 | GPU 24GB가 있으면 쾌적하다 |

중요한 제약이 하나 있다: Claude Code는 최소 64K 컨텍스트를 요구한다. Ollama 로컬 모델을 쓸 때 기본 컨텍스트가 작게 잡혀 있으면 에이전트 루프 중간에 잘리므로 OLLAMA_CONTEXT_LENGTH=65536과 같은 방식으로 늘려 주어야 한다.

로컬 모델 설치는 단순하다.

ollama pull qwen3.5

ollama pull glm-4.7-flash

클라우드 모델은 ollama signin으로 로그인만 해두면 바로 쓸 수 있다.

GPU가 없을 때 대안

CPU만으로 돌리면 7B 모델조차 토큰당 5초 이상이 걸려 사실상 쓸 수 없다. 이런 경우 선택지는 두 갈래이다.

- Ollama Cloud (가장 간단):

qwen3.5:cloud,kimi-k2.5:cloud와 같은:cloud태그 모델을 로컬 클라이언트에서 그대로 호출한다. 공식 통합이라 추가 프록시가 불필요하다. 무료 쿼터는 제한이 있으나 개인용으로는 대체로 충분하다. - 써드파티 무료 API + claude-code-router: Groq(분당 30 요청), OpenRouter 무료 카테고리, Cerebras(월 100만 토큰) 같은 OpenAI 호환 API를 써야 할 때는 라우터를 끼워서 연결한다. Ollama 통합보다 설정이 한 단계 더 필요하다.

Claude Code와 Ollama를 실제로 연결하는 방법

여기가 핵심이다. 공식 통합이라 10분이면 끝난다. 두 가지 방식을 모두 정리한다.

방식 A: 초간단 원라이너 (공식 권장)

Ollama 0.12+부터 launch 서브커맨드가 포함되어 있다. 한 줄이면 된다.

ollama launch claude

모델을 특정하고자 하면 --model을 붙이면 된다.

ollama launch claude --model kimi-k2.5:cloud

이 명령어가 내부적으로 수행하는 작업은 다음과 같다.

- Ollama 데몬 구동 확인 (실행 중이 아니면 기동한다)

ANTHROPIC_AUTH_TOKEN=ollama,ANTHROPIC_API_KEY="",ANTHROPIC_BASE_URL=http://localhost:11434세팅- Claude Code CLI를 지정 모델로 실행

여기서 끝이다. Claude Code 인터페이스는 그대로 뜨는데 백엔드는 Ollama가 돌린다. 토큰 사용량은 0이다.

방식 B: 환경변수 직접 설정

셸 설정에 박아 두거나 자동화 스크립트에 태울 예정이라면 수동 세팅이 편하다.

export ANTHROPIC_AUTH_TOKEN=ollama

export ANTHROPIC_API_KEY=""

export ANTHROPIC_BASE_URL=http://localhost:11434

claude --model qwen3.5

한 줄 인라인으로 쓰고자 한다면 다음과 같이도 된다.

ANTHROPIC_AUTH_TOKEN=ollama ANTHROPIC_BASE_URL=http://localhost:11434 ANTHROPIC_API_KEY="" claude --model glm-5:cloud

Windows PowerShell이라면 아래처럼 변환하면 된다.

$env:ANTHROPIC_AUTH_TOKEN="ollama"

$env:ANTHROPIC_API_KEY=""

$env:ANTHROPIC_BASE_URL="http://localhost:11434"

claude --model qwen3.5

포인트는 세 가지이다. ANTHROPIC_AUTH_TOKEN은 ollama라는 고정 문자열이고, ANTHROPIC_API_KEY는 빈 문자열이며, ANTHROPIC_BASE_URL은 Ollama 기본 포트 11434로 직접 꽂는다. 중간 프록시는 없다.

환경변수 함정 체크리스트

Windows에서 자주 막히는 지점들이다.

CLAUDE_CODE_GIT_BASH_PATH가 잡혀 있지 않으면 git-bash를 찾지 못한다.D:\Program Files\Git\bin\bash.exe같은 절대 경로를 주어야 한다.ANTHROPIC_API_KEY는 빈 문자열("")로 주는 것이 포인트이다. 예전 라우터 방식에서는 더미값을 넣었지만 공식 통합에서는 빈값이 맞다.- WSL에서 띄운 Ollama를 Windows 호스트에서 접근하려면

OLLAMA_HOST=0.0.0.0 ollama serve로 기동해야 한다. - 컨텍스트가 64K 미만이면 에이전트 루프 중간에 끊긴다.

OLLAMA_CONTEXT_LENGTH=65536환경변수로 올려 주거나ollama run시/set parameter num_ctx 65536을 걸어야 한다.

설정 검증 체크리스트

작동하는 줄 알았는데 실제로는 망가져 있을 수 있다. 이 세 가지만 통과하면 일단 합격이다.

- Tool Use 호출:

ls 명령으로 디렉토리 확인해줘같은 단순 요청을 돌려 Bash 툴이 호출되는지 확인한다. - 긴 응답: 2000자 이상 코드 생성을 시켜 중간에 끊기지 않는지 확인한다 (64K 컨텍스트 세팅 검증용이다).

- 스트리밍: 토큰이 한 번에 떨어지지 않고 흘러나오는지 확인한다 (Ollama는 기본적으로 스트리밍을 지원한다).

출처: mcpcat.io

써 보고 느낀 현실적인 한계

솔직하게 말하면, 이것을 하루 종일 쓰다 보면 한계가 명확해진다.

에이전트 루프 성공률 차이

Sonnet 4.5는 복잡한 5단계 작업을 한 번에 끝까지 끌고 가는 능력이 탁월하다. 로컬 모델은 체감 60~75% 수준이다. 중간에 한 번 헷갈리면 전혀 다른 방향으로 산으로 가는 경우가 많다. 특히 파일이 많아지면 "이 파일에서 무엇을 봐야 하는지" 판단이 흐려진다.

Tool Use JSON 포맷이 튄다

Anthropic 모델은 Tool Use 호출 형식을 거의 99% 정확히 지킨다. qwen3.5나 glm-5:cloud도 95% 이상이지만, 가끔 JSON에 trailing comma를 넣거나 따옴표 한쪽만 닫는 경우가 있다. Ollama 네이티브 엔드포인트가 일부 정규화해 주기는 하나 완벽하지는 않다.

한국어 품질의 컨텍스트 의존성

128K 컨텍스트를 절반 이상 채우면 한국어 답변 품질이 눈에 띄게 떨어진다. 영어 코드는 멀쩡한데 주석이나 설명이 어색한 일본어처럼 변하기도 한다. 큰 코드베이스를 분석할 때는 영어로 질문하는 편이 결과가 낫다.

Claude Code 무료 세팅보다 유료가 더 이득인 상황

기준을 명확히 제시한다. 다음 중 두 가지 이상에 해당된다면 Max 결제가 시간 절약이다.

- 매일 4시간 이상 코딩 에이전트를 돌린다.

- 동시에 작업하는 프로젝트가 3개 이상이다.

- 클라이언트에게 결과물을 납품할 시간이 박혀 있다.

- GPU 사양이 부족하거나 전기세가 비싸다.

반대로 학습용/취미용/사이드 프로젝트라면 로컬 LLM이 압도적으로 합리적이다.

비용 계산을 실제로 해 보았다

추상적으로 "싸다"가 아니라 숫자로 까 본다. 1년 기준이다.

유료 옵션

- Claude Max $200/월 × 12 = $2,400 (약 330만원)

- Claude Pro $20/월 × 12 = $240 (약 33만원)

로컬 옵션 (RTX 4090 기준)

- 중고 RTX 4090 24GB: 약 250만원 (2026년 4월 시세)

- 전기세: 평균 350W 사용 × 하루 6시간 × 365일 = 766kWh ≈ 약 12만원/년

- 1년차 총액: 약 262만원

- 2년차부터: 연 12만원만 든다

2년 이상 쓸 계획이라면 GPU를 사는 편이 무조건 이득이다. 게임도 함께 돌리면 더욱 이득이다. 다만 1년만 쓰고 말 생각이라면 Max가 낫다.

하이브리드 전략 (실제로 추천하는 조합)

- 로컬

qwen3.5로 평소 단순 작업 (0원) - 어려운 에이전트 루프는

kimi-k2.5:cloud로 잠깐 올린다. - 정말 복잡한 아키텍처 설계는 Anthropic Pro로 가끔 돌린다.

월 $5~$20 정도로 거의 무제한급 작업이 가능하다. 회사에서 외부 API가 차단된 환경이라면 qwen3.5 + glm-4.7-flash 로컬 단일 조합으로 가야 한다.

상황별 추천 조합

- 학생/취준생:

ollama launch claude --model qwen3.5한 줄. 비용 0원이다. - 프리랜서: 로컬 qwen3.5 + Ollama Cloud

kimi-k2.5:cloud쿼터를 섞어 운영한다. - 기업 보안 환경: 로컬

qwen3.5+glm-4.7-flash두 개만. 외부 호출은 0이다. - 하이엔드 시니어: Max $200을 결제하고 신경을 끄는 편이 시간 비용상 이득이다.

자주 묻는 질문

"코딩 에이전트로 정말 실무가 가능한가?"

CRUD 수준이나 단일 파일 리팩토링은 거의 차이가 없다. 마이크로서비스 전체 설계나 모놀리식 코드베이스의 대규모 변경은 Sonnet이 압도적이다. 본인 작업의 70%가 단순 작업이라면 로컬로도 충분하다.

"애플 실리콘에서는 빠른가?"

M3 Max 64GB 기준으로 qwen3.5를 돌리면 토큰당 약 30 t/s가 나온다. RTX 4090보다는 느리지만 충분히 쓸만한 속도이다. M1/M2도 16GB 이상이면 glm-4.7-flash는 잘 돈다.

"Cursor나 Cline을 쓰는 것과 무엇이 다른가?"

Cursor는 별도 IDE라 학습 비용이 있고 유료이다. Cline은 VSCode 확장이며 Claude Code와 가장 유사한데, 자체 에이전트 루프가 Claude Code보다는 살짝 부족하다. Claude Code의 강점인 Task, Plan, TodoWrite 흐름을 Ollama에서도 그대로 쓰고자 한다면 이 글의 방식이 답이다.

"Ollama Cloud 모델을 쓰면 정말 무료인가?"

:cloud가 붙은 모델은 Ollama 계정이 필요하고 무료 티어는 쿼터 제한이 있다. 유료 플랜도 Claude Max보다는 훨씬 저렴하다. 완전 0원으로 쓰려면 로컬 모델(qwen3.5, glm-4.7-flash)만 써야 한다. 하이브리드로 평소에는 로컬, 어려운 것은 :cloud로 올리는 방식이 실용적이다.

"ollama launch claude가 실행되지 않는다면?"

Ollama 버전이 오래된 경우 launch 서브커맨드가 없다. ollama --version으로 확인하고 0.12+가 아니라면 재설치한다. 그 이전 버전을 쓸 예정이라면 방식 B의 환경변수 수동 세팅으로 우회할 수 있다.

무료로 쓰려면 이대로만 따라하면 된다

정리하면 핵심은 세 줄이다.

- Claude Code 무료 사용의 핵심은 Ollama 공식 통합을 활용하는 것이다.

ANTHROPIC_BASE_URL=http://localhost:11434+ANTHROPIC_AUTH_TOKEN=ollama조합이다. - 2026년 현재 가장 쉬운 방법은

ollama launch claude --model qwen3.5한 줄이다. 프록시나 라우터 세팅이 전혀 필요 없다. - 로컬 모델은 단순 작업/학습용으로는 충분하나, 복잡한 에이전트 루프는 Sonnet을 따라가지 못한다. 어려운 작업은

kimi-k2.5:cloud로 올리는 하이브리드가 실전 최적이다.

추천 무료 세팅 한 줄 요약은 ollama launch claude이다. 이것 하나면 Anthropic 구독 0원으로 Claude Code 인터페이스를 그대로 쓸 수 있다.

더 깊이 파고들고자 한다면 Ollama × Claude Code 공식 가이드, Anthropic 공식 Claude Code 문서, Ollama 공식 사이트 세 곳을 정독하면 된다. 모델 비교는 r/LocalLLaMA 서브레딧이 가장 빠르고 정확하다.

직접 셋업해 보다가 막히면 댓글로 환경(OS, GPU, 모델)을 적어 주기 바란다. 같은 함정에 빠져 본 사람들끼리 함께 풀어 가는 것이 가장 빠르다. 이제 진짜로 Claude Code 무료로 실컷 굴려 보고, 한도 걱정 없이 코딩하는 맛을 경험해 보기 바란다.

'AI LLM' 카테고리의 다른 글

| 구글이 공개한 DESIGN.md, 이것이 무엇이기에 이토록 주목받는가 (0) | 2026.04.22 |

|---|---|

| Claude AI 강의 13개 (13 Claude AI Courses)가 무료로 공개되었는데, 전부 수강해야 하는가? (0) | 2026.04.21 |

| Claude Opus 4.7 무엇이 달라졌는가 — 4.6과 비교 정리 (0) | 2026.04.19 |

| 개발은 Claude Code, 테스트는 Codex? 한 달 사용 후기를 정리한다 (0) | 2026.04.19 |

| Claude Code 유출 정리 - 여기서 인사이트를 뽑아간 개발자들이 왜 더 빨리 달리는가 (0) | 2026.04.19 |